评估“易翻译”的翻译质量,建议用一套可操作的、多维度且以人工为核心的评分体系:将准确度(adequacy)和可懂度(fluency)作为主轴,辅以术语一致性、风格贴合、格式与本地化保真等维度;采用明确的分级量表(0–100或0–5)、权重加权汇总,再结合自动化指标(BLEU/BERTScore/COMET)做辅助监控;通过双盲人工标注、标注准则与一致性检验(如Cohen’s κ)、置信区间评估与定期抽检,形成数据驱动的持续改进闭环,既可量化当前水平,也能指导模型与产品优化,最后将评分标准文档化以便复制与长期追踪,便于决策。

先说结论(我怎么想的)

其实评估翻译质量不是一次任务就能搞定的,它既要回答“译文有没有把原文意思传达清楚”,又要看“读者读起来顺不顺”,还要考虑应用场景(比如合同、聊天、UI 文案、游戏对白)。理想的做法是把这些维度拆开量化,然后把人工评估放在核心位置,用自动指标来做大规模监控和回归检测。

为什么要用多维评价?

简单地给出一个单一分数看起来省事,但它掩盖了很多细节:有的译文意思准确但语句生硬,有的读起来舒服但误译了关键术语。对于产品改进、客户投诉处理、以及模型迭代,分维度的数据能告诉你究竟哪块出了问题。

核心维度(要评什么)

- 准确度(Adequacy / Fidelity):信息是否被完整且正确地传达?重要错误会造成误解或业务损失。

- 可懂度 / 流畅性(Fluency / Naturalness):语法、用词和句子连贯性,是否符合目标语言的表达习惯。

- 术语一致性(Terminology / Consistency):专有名词、行业术语是否统一、符合规范。

- 风格与语域(Style / Register):文体是否与场景匹配(正式/口语/技术/营销)。

- 格式与标签保留(Formatting / Tagging):是否保留了原文中的特殊格式、占位符、HTML 标签等。

- 本地化(Localization):是否处理了货币、单位、时间、文化相关元素。

- 时效性与稳定性(Latency / Stability):响应时长和结果是否一致(对用户体验重要)。

如何把这些维度量化(评分体系)

把每个维度做成单独的评价项,定义明确的评分等级和示例,然后给每个维度分配权重,最后做加权平均。

示例评分等级(0–5 分制)

| 分数 | 含义说明 |

| 5 | 完美:无误译、表达自然、风格到位,格式与术语完全符合要求。 |

| 4 | 优秀:轻微用词或风格问题,但不影响理解。 |

| 3 | 合格:有明显表达或术语问题,但核心信息仍可获取。 |

| 2 | 较差:存在误译或重要信息丢失,可能导致误解。 |

| 1 | 严重错误:关键信息错误或缺失,无法使用。 |

| 0 | 不可理解或完全跑题。 |

权重示例与总分计算

不同应用场景权重会不同。举个办公/合同类的典型权重:

- 准确度:40%

- 术语一致性:15%

- 可懂度/流畅性:25%

- 格式/标签保留:10%

- 本地化:10%

计算方式(将 0–5 分换算为 0–100 分):

总分 = Σ(维度得分 × 维度权重)

例如:准确度 4(80分)×40% + 可懂度 3(60分)×25% + … = 最终百分制分数。

人工评估的实施细节(这块是关键)

机器能跑全量,但人工能判断细微语义。建议采用双盲标注、明确的标注手册和示例。

标注手册要包含

- 每个维度的定义、评分标准和充足示例(正反例)。

- 常见争议类型与优先级(比如术语错误优先于轻微语法问题)。

- 标注流程(谁抽样、什么比例、如何记录纠错建议)。

- 标注工具与界面说明(支持并排对照、备注、标签)。

一致性与质量控制

- 双盲评审:每条样本至少两名标注员独立打分;冲突样本由第三位仲裁。

- 计算标注一致性:用 Cohen’s κ 或 Fleiss’ κ 来量化(κ>0.6 为较好,>0.8 为很好)。

- 样本量与置信区间:要估计总体分数,需要合理样本量。一般来说,几百条多领域样本是基本要求;用二项/正态近似计算置信区间。

- 标注员培训与再校准:定期举办打分校准会议,更新标注手册。

自动化指标:能干什么,不能干什么

自动指标用于大规模回归检测和快速筛查,但不能替代人工判断。

常见自动指标速览

- BLEU:基于 n-gram 的表面匹配,适合翻译质量趋势检测,但对意译、同义替换敏感度低。

- TER:编辑距离,直观反映改动量,但不能区分可理解性。

- chrF:字符 n-gram,短语和形态变化下表现更稳健。

- BERTScore:基于语义嵌入,能捕捉同义替换,对语义保持检测较好。

- COMET / BLEURT:训练有监督的综合指标,相关性通常比 BLEU 高,但依赖训练数据与偏差。

使用建议:把自动指标作为报警器(回归、模型切换前后比对、A/B 测试的快速指标),对于最终质量评级仍以人工为准。

把人工评估和自动指标结合起来(一个可复用的方案)

设计一个混合评分管道:

- 定期抽样(按语言、领域、用户量加权抽样)——>做人工多维打分。

- 并行计算自动指标(BLEU/BERTScore/COMET)用于趋势对齐。

- 用回归/相关分析检查自动指标与人工总分的相关性,若相关性低,更新或放弃该自动指标。

- 最终用人工分数训练一个轻量级回归模型(或校准表)把自动指标映射到“预期人工分数”,用于在线估计。

示例公式(示范用)

可定义“综合质量得分 Q”:

Q = α × H + (1−α) × A

其中 H 是人工评估的百分制平均分,A 是自动指标映射到百分制的分值(比如把 BERTScore 归一化到 0–100),α 为人工权重(建议 α≥0.6)。

采样与统计考虑(别只看平均数)

要报告:均值、中位数、分位数(P10, P90)、标准差,以及按领域/语言分层的结果。若只看平均数,容易被少量极端样本掩盖问题。

- 置信区间:对平均分给出 95% 置信区间,评估改进是否显著。

- A/B 测试:在模型迭代前后做盲测,用统计检验(t 检验或非参数检验)判断是否有显著提升。

- 错误分类统计:按错误类型(误译、漏译、格式错、风格错)统计出现频率,以便优先改进。

对“易翻译”产品的特别建议(结合场景)

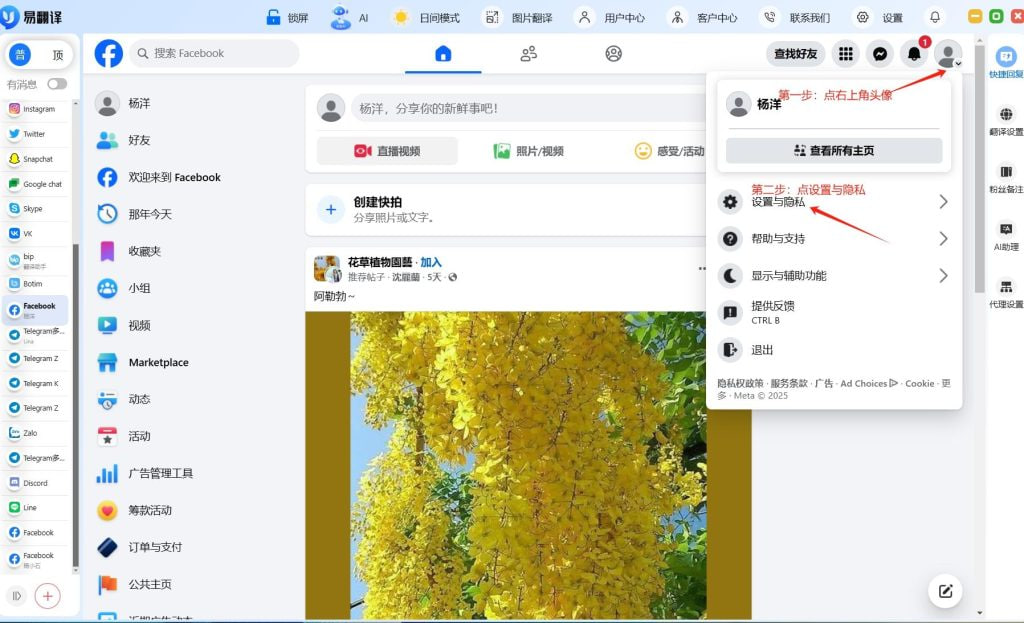

说点更贴合实战的:作为一款多平台的网络加速翻译工具,要兼顾离线/在线、短文本/长文本、UI 文案/对话流/技术文档等多种场景。

- 短句场景(UI、通知):把可懂度和格式保留权重放高,术语要求一般。

- 合同/技术文档:准确度和术语一致性放首位,允许更慢的后处理或人工复核。

- 对话场景(聊天、客服):优先考虑风格与上下文连贯性,实时性要求高。

- 游戏本地化/营销:本地化与创意翻译的放权重高,通常需要人工润色团队。

监控与 SLA 建议

对于线上翻译服务,建议定义如下 SLA 指标并监控:

- 可用性(99.9% 以上)

- 延迟 P95(如 < 500ms 对实时聊天重要)

- 自动回归告警(当自动指标与历史均值差距超过阈值)

- 人工抽样合格率(目标:80% 以上为良好,90% 以上为优秀,视场景而定)

实例:如何给一条翻译做评分(实操演示)

原句(EN):“The server will be deprecated next month.”

译文 A:服务器将在下个月被弃用。

译文 B:该服务器下月不再维护。

- 准确度:A(5分,信息完整);B(4分,意思对但语义侧重点有差异)。

- 可懂度:A(4分,翻译生硬但可理解);B(5分,更口语化)。

- 术语一致性:若上下文中“deprecated”需用“弃用”或“淘汰”则 A 更合适;评分依具体术语表。

假设权重:准确度 40%,流畅度 30%,术语 30%。A 的加权得分可能高于 B(如果严格要求术语),但在用户服务场景 B 可能更受欢迎。这就提醒我们:不同场景需要不同权重。

常见坑与避免方法(别踩雷)

- 仅用 BLEU 做决策:会忽视语义层面的错误。

- 标注规则不明确:导致标注员打分差异大。

- 样本偏差:只抽热门语言或常见短句,会错估实际质量。

- 忽视用户场景:未按最终用户的阅读习惯和业务后果来设置阈值。

长期改进与组织实践

把质量评价嵌入到产品生命周期:模型训练 -> 离线评估(人工+自动)-> 小流量灰度 -> 全量部署 -> 在线监控 -> 人工抽检 -> 反馈到数据/模型。保持标注手册的版本控制和变更记录,便于追溯。

团队角色与职责

- 产品/PM:定义场景与业务优先级,设定质量目标与阈值。

- 语言专家/译审:撰写标注手册,做高质量人工评估与仲裁。

- 数据工程师:实现抽样、采集与指标计算管道。

- 研发/算法:根据评价结果调整模型、优化推理速度与部署策略。

可视化与报告(让数据可读)

报告要包含:总体评分趋势、按语言/场景分布、错误类型占比、A/B 测试结果与置信区间、关键样本示例。可视化能帮助不同角色快速理解问题严重性与优先级。

最后,几点现实建议(边想边写的那些话)

- 先从简单的评分体系做起(准确度+流畅度+基本术语),把流程跑通,再逐步细化。

- 别把自动指标当金科玉律,它们是好用的看门狗,但不够聪明。

- 持续做用户调研:用户对“可用”的定义往往比系统设计者更朴素、更实际。

- 把质量数据用在优先级排序上,而不是一味追求微小平均分提升。

如果你愿意,我可以帮你把上面那个评分表格(0–5 的量表、各场景权重建议)做成可直接导入标注工具的 JSON 或 Excel 模板,或者按“易翻译”的具体语言对(比如中英、中日等)给出首批抽样方案和 500 条参考样本分配建议,哪种先做?