易翻译在处理韩语收音时,先用手机麦克风采集音频,经过降噪、回声消除与语音活动检测裁剪有效段,送往韩语ASR模型转写,随后再交给翻译引擎生成目标语文本;联网时通常使用云端模型以提升识别率,离线则依赖本地轻量模型和本地预处理以优化收音。

从头说起:声音到翻译的那条路

想象一下,你和朋友面对面说话,耳朵把声波变成信号,脑子理解并回应。手机上的翻译App做的工作很类似,只不过把“耳朵”和“大脑”拆成了很多电子模块:麦克风采集(相当于耳朵)、预处理(像是清洗信号)、语音识别ASR(把声音变成文字)、语言处理和翻译模块(把文字变成另一种语言)、再把结果展示出来。

关键环节一:收音(麦克风与采样)

- 麦克风类型:手机自带的麦克风通常是全向或指向式的,外接麦克风(领夹、指向话筒)能显著改善信噪比。

- 采样率与量化:语音识别常用16kHz、16bit单声道足以覆盖人声带,音乐或高保真场景会用44.1kHz或48kHz。过高采样会增加网络带宽和计算负担。

- 自动增益与裁剪:设备会自动调整输入增益(AGC),但过强增益会导致失真,过强背景噪音会把有效语音淹没。

- 系统权限:在iOS/Android上必须允许麦克风权限,否则App无法收音,这是很多识别失败的首因。

关键环节二:预处理——把噪音和回声请出去

在送去识别前,音频通常会经过几步“清理”:

- 降噪(Noise Reduction):用算法减少背景持续噪音(风声、空调、电机声)。

- 回声消除(AEC):当扬声器播放音频同时麦克风也在拾音时,会产生回声,AEC把麦克风中来自扬声器的部分去掉。

- 语音活动检测(VAD):把有说话的段落截取出来,节省传输与计算量,也能减少误触发。

- 波形切割与归一化:把音量标准化,去掉过短的噪音峰值。

关键环节三:ASR(语音识别)与韩语特点

韩语有自己的结构特点,这会影响识别策略:

- 韩语是黏着语,动词和助词容易连缀,分词和形态分析比英语复杂。

- 韩文字母构成音节块(Hangul),但书写与口语断句有差异,ASR需要做韩语断句与词性恢复。

- 敬语体系(平语、敬语)会影响句子结构与词形,需要语言模型理解上下文。

- 方言与口音:首尔腔、釜山腔等在发音上有差别,遇到地方口音会降低识别率。

易翻译会怎么做(基于行业常见做法)

由于我无法查看易翻译的源代码,我就讲讲行业里常见的做法,这些也很可能是易翻译在处理韩语收音时遵循的路线。

流式传输 vs 批量上传

- 流式(实时):App把音频分片通过WebSocket或类似协议持续上传,云端ASR边接边识别,延迟低,适合双语对话场景。

- 批量(录音上传):先录一段音频,上传后做离线或云端识别,适合噪声较大或需要高精度的会议录音。

云端模型与本地离线模型的权衡

云端模型通常更强、更新更快,可以用更大的语料训练出更好的韩语识别效果,但需要网络和传输时间;离线模型响应快、隐私性强,但模型尺寸通常受限,精度略低,尤其面对方言或长句子时。

文本后处理与翻译链路

ASR产出往往缺标点、大小写和语义断句,后续会有:

- 断句与标点恢复

- 命名实体识别(人名、地名)

- 敬语级别判定(以便翻译成对应礼貌级别)

- 翻译引擎把韩语文本映射成目标语(规则+神经网络混合)

用户角度:如何在易翻译中优化韩语收音

这部分是最实用的:无论App内部多强,收音质量好坏往往决定最终效果。下面的建议既适用于易翻译,也适用于其他实时翻译工具。

基础设置与操作步骤

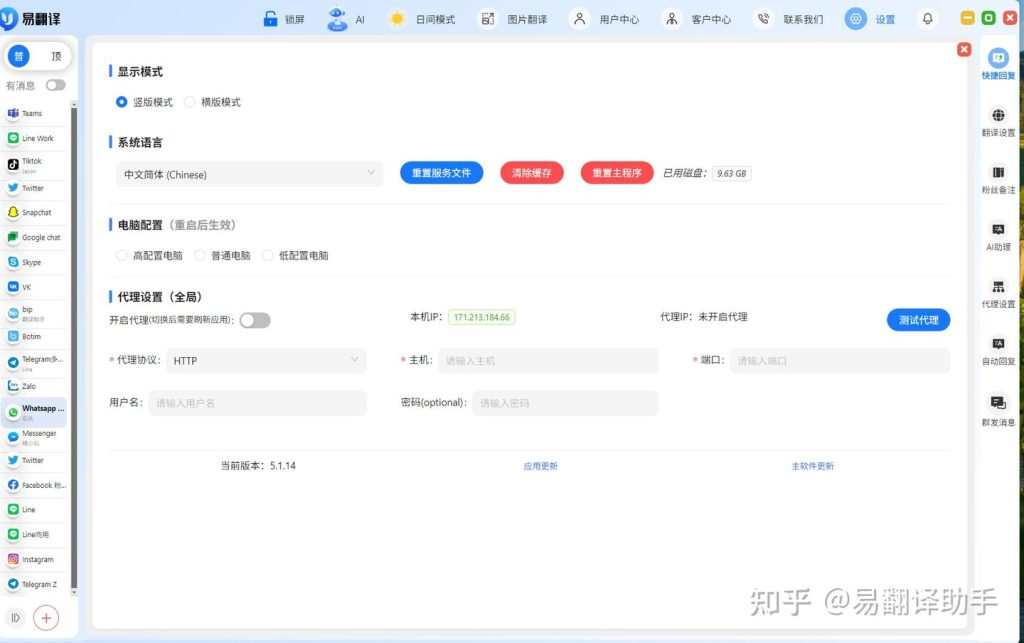

- 打开App并允许麦克风权限;

- 在语言选择中把源语言设为“韩语(한국어)”;

- 选择合适的输入模式:实时对话/连续识别/按键对话(Push-to-Talk);

- 若有“噪声抑制”“回声消除”开关,根据环境开关之;

- 有外接麦克风时优先使用,避免靠近扬声器以减少回声;

- 网络不稳时考虑切换到离线模式或先录音后上传识别。

收音技巧清单

- 安静的环境:尽量远离风、空调、车流和人群;

- 靠近麦克风:离麦克风20–30厘米通常较合适;

- 避免重叠说话:多人同时说话会让ASR难以分辨;

- 适当说慢一点:韩语连读现象普遍,说太快会丢词;

- 使用有线耳麦:在现场会议/采访,指向性话筒或领夹麦效果好;

- 注意口音和敬语:尽量用标准发音和明确的句尾,尤其在商务场合。

技术细节一览(给好奇的你)

下面是一些常见的技术参数与建议值,帮助你理解为什么会有那些设置以及怎么调优。

| 项目 | 常见/推荐值 | 说明 |

| 采样率 | 16 kHz(语音) / 44.1–48 kHz(高保真) | 16 kHz足以覆盖人声带,带宽与识别成本更低。 |

| 声道 | 单声道(Mono) | 单声道对语音识别来说更简单且数据更小;多通道用于扬声器分离和方位识别。 |

| 编码 | PCM或低延迟语音编解码器(OPUS) | 无损或低延迟编解码器能保留更多语音细节,按需选择。 |

| 延迟要求 | <300 ms(实时对话) | 延迟越低,对话体验越好,但对网络与计算要求也高。 |

遇到问题怎么办?常见状况与解决办法

- 识别结果里有很多错词:检查麦克风距离、背景噪音;确认选择了韩语源语言;尝试外接麦克风或录音后上传识别。

- 总是少词或被截断:可能是VAD阈值设置过高或网络丢包,尝试切换到“连续识别”或提高录音音量。

- 翻译礼貌级别不对:手动在翻译目标语中选择正式/非正式,或在输入前用短句注明语气(例如“用敬语”)。

- 离线识别准确率低:这是离线模型容量限制导致的,建议在有网络时用云端识别。

- 多人对话难以分别:使用外接定向麦克或专业录音设备,或先做录音再用会议转写服务。

问题—解决快速表

| 问题 | 可能原因 | 快速修复 |

| 听不清/噪音大 | 环境噪音、麦克位置不当 | 换到安静处或用指向麦克、靠近麦克 |

| 识别错误多 | 口音、连读、速率过快 | 放慢语速、分句说、尝试离线校正 |

| 回声/自说自唱 | 扬声器与麦克同时工作 | 开启回声消除或用耳机 |

特殊场景与进阶建议

不同场景会有不同的“最佳实践”。我把常见的几个说一下,算是实战贴:

旅行与街头对话

- 尽量靠近麦克风说话,背景噪音大时移步较安静处;

- 用短句,避免俚语和连读;

- 若对方说得快,礼貌地请对方放慢或重复。

商务会议与多方通话

- 优先使用外接会议麦克或桌面定向麦克风;

- 若进行远程会议,先做一次测试录音检验识别效果;

- 多人发言时启用说话人分离或手动标注说话人名。

录音后处理(录音-上传-转写)

噪音太多或需要高精度时,先录音、后上传通常比实时翻译更稳妥。录音文件可以做更复杂的后处理(多通道分离、降噪深度处理),再用更强的云端模型识别与翻译。

几个容易忽略但很关键的小细节

- 时间戳与断句:若需要逐句对应音频与文本,启用时间戳输出功能;这对字幕、会议纪要很重要。

- 术语库/用户词表:专业场景(医学、法律、技术)可上传词表以提高专有名词识别率。

- 隐私与数据存储:云端识别可能会把音频上传到服务器,注意查看隐私政策与是否支持不上传或本地处理。

- 更新与模型升级:App与语言包更新会带来识别改进,遇到问题先尝试更新应用。

好啦,写到这里,我也边想边把这些经验整理出来,可能还有一些小细节会随版本优化而变——比如某次更新把降噪算法改了,识别率就跳高了。所以,实际使用时多试几种设置、做几次小测试,会比单看说明更快找到最合适的方案。祝你在韩语交流里少走弯路,遇到具体问题随时可以再问我,我还能帮你一步步排查。